Želite pametnije uvide u vašu pristiglu poštu? Prijavite se za naše tjedne biltene kako biste dobili samo ono što je važno za vođe AI, podataka i sigurnosti. Pretplatite se sada

AI predstavlja najveći kognitivni opterećenje u povijesti čovječanstva. Jednom smo prenijeli memoriju na pisanje, aritmetiku kalkulatorima i navigaciju na GPS. Sada počinjemo prebaciti prosudbu, sintezu, pa čak i stvaranje značenja u sustave koji govore naš jezik, naučimo naše navike i prilagođavaju naše istine.

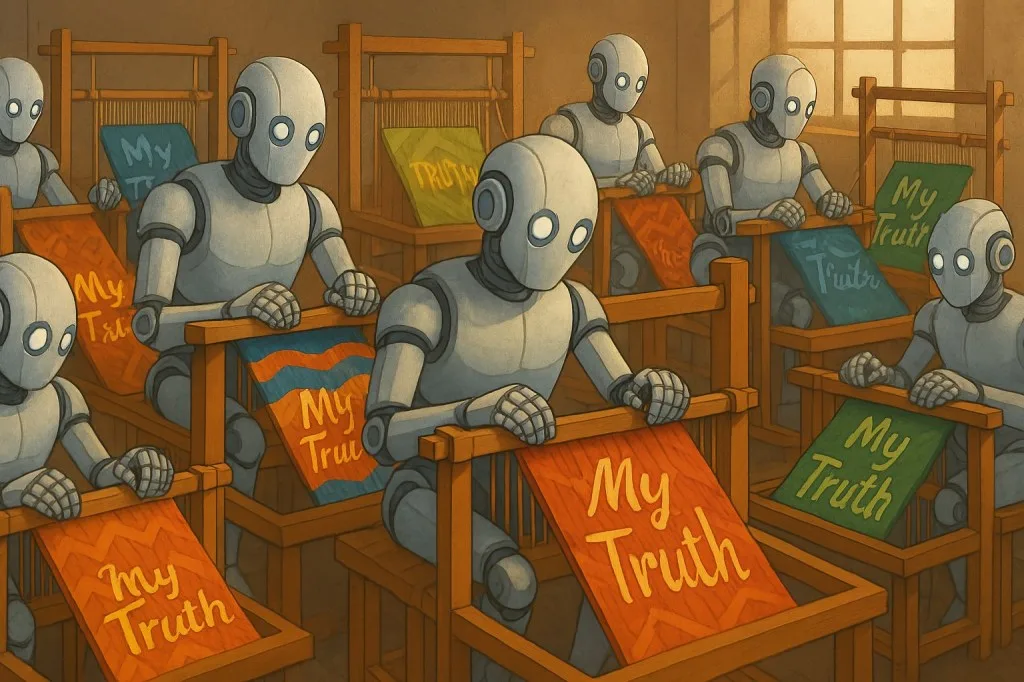

AI sustavi postaju sve vještiji u prepoznavanju naših sklonosti, naših pristranosti, čak i naših peccadillosa. Kao i pažljivi sluge u jednom slučaju ili suptilni manipulatori u drugom, oni prilagođavaju svoje odgovore kako bi udovoljili, uvjerili se, pomogli ili jednostavno zadržali našu pažnju.

Iako se neposredni učinci mogu činiti benignim, u ovom tihom i nevidljivom podešavanju leži dubok pomak: verzija stvarnosti koju svaki od nas prima postaje progresivno jedinstvenija prilagođena. Kroz ovaj postupak, s vremenom svaka osoba postaje sve više njihov otok. Ova divergencija mogla bi ugroziti koherentnost i stabilnost samog društva, narušavajući našu sposobnost da se dogovorimo o osnovnim činjenicama ili se krećemo u zajedničkim izazovima.

AI personalizacija ne služi samo našim potrebama; Počinje ih preoblikovati. Rezultat ovog preoblikovanja je vrsta epiztemskog odljeva. Svaka osoba počinje se kretati, centimetar po centimetar, daleko od zajedničkog temelja zajedničkog znanja, zajedničkih priča i zajedničkih činjenica i dalje u svoju stvarnost.

Serija AI Impact vraća se u San Francisco – 5. kolovoza

Sljedeća faza AI je ovdje – jeste li spremni? Pridružite se vođama iz Block, GSK i SAP-a za ekskluzivni pogled na to kako autonomni agenti preoblikovaju radne tokove poduzeća-od odlučivanja u stvarnom vremenu do automatizacije krajnjeg do kraja.

Osigurajte svoje mjesto odmah – prostor je ograničen: https://bit.ly/3guuplf

To nije samo stvar različitih vijesti. To je sporo odstupanje moralnih, političkih i međuljudskih stvarnosti. Na taj način možemo biti svjedoci neslaganja kolektivnog razumijevanja. To je nenamjerna posljedica, ali duboko značajna upravo zato što je nepredviđena. Ali ta fragmentacija, dok ga je sada ubrzala AI, počela je mnogo prije nego što su algoritmi oblikovali naše feedove.

Sadržaj objave

Neobjavljeno

Ovo neometanje nije počelo s AI. Kao što se David Brooks odražavao u AtlantikOslanjajući se na rad filozofa Alasdaira MacIntyre -a, naše društvo stoljećima se udaljavalo od zajedničkih moralnih i epiztemskih okvira. Od prosvjetiteljstva, postupno smo zamijenili naslijeđene uloge, komunalne pripovijesti i dijelili etičke tradicije s individualnom autonomijom i osobnim preferencijama.

Ono što je počelo kao oslobađanje od nametnutih sustava vjerovanja s vremenom je narušilo same strukture koje su nas jednom vezale za zajedničku svrhu i osobno značenje. AI nije stvorio ovu fragmentaciju. Ali daje mu novi oblik i brzinu, prilagođavajući ne samo ono što vidimo, već i kako tumačimo i vjerujemo.

To nije za razliku od biblijske priče o Babelu. Jedinstveno čovječanstvo jednom je dijelilo jedan jezik, samo da bi se slomio, zbunjen i raštrkao činom koji je međusobno razumijevanje sve, ali nemoguće. Danas ne gradimo toranj izrađen od kamena. Izgrađujemo sam toranj jezika. Još jednom riskiramo pad.

Veza čovjeka-stroj

U početku je personalizacija bila način da se poboljšaju “ljepljivost” tako što će korisnike duže angažirati, češće se vraćati i dublje komunicirati s web mjestom ili uslugom. Preporučni motori, prilagođeni oglasi i kurirani feedovi bili su osmišljeni kako bi našu pažnju zadržali još malo, možda da bismo zabavili, ali često da nas pomaknu za kupnju proizvoda. Ali s vremenom se cilj proširio. Personalizacija se više ne odnosi samo na ono što nas drži. To je ono što zna o svakome od nas, dinamični grafikon naših sklonosti, uvjerenja i ponašanja koji postaje sve rafiniraniji sa svakom interakcijom.

Današnji AI sustavi ne predviđaju samo naše sklonosti. Cilj im je stvoriti vezu kroz visoko personalizirane interakcije i odgovore, stvarajući osjećaj koji AI sustav razumije i brine o korisniku i podržava njihovu jedinstvenost. Ton chatbota, koračanje odgovora i emocionalna valencija prijedloga kalibrira se ne samo radi učinkovitosti, već i za rezonancu, usmjeravajući prema korisnije doba tehnologije. Ne bi trebalo biti iznenađujuće da su se neki ljudi čak i zaljubili i oženio se njihovim botovima.

Stroj se prilagođava ne samo onome što kliknemo, već i onome što se činimo. To nas odražava natrag na sebe na načine koji se osjećaju intimnim, čak i empatičnim. Nedavni istraživački rad naveden u Priroda To se odnosi kao na “socioafektivno usklađivanje”, proces kojim AI sustav sudjeluje u zajedničkom socijalnom i psihološkom ekosustavu, gdje se preferencije i percepcije razvijaju kroz međusobni utjecaj.

Ovo nije neutralan razvoj. Kad je svaka interakcija prilagođena laskavoj ili afirmi, kada nas sustavi previše dobro odražavaju, zamagljuju liniju između onoga što odjekuje i onoga što je stvarno. Ne ostajemo samo duže na platformi; Mi formiramo vezu. Polako se i možda neumoljivo spajamo s verzijom stvarnosti posredovane AI, onom koja je sve više oblikovana nevidljivim odlukama o onome što smo trebali vjerovati, željeti ili vjerovati.

Ovaj proces nije znanstvena fantastika; Njegova arhitektura izgrađena je na pažnji, učenje pojačanja s ljudskim povratnim informacijama (RLHF) i personalizacijskim motorima. To se događa i bez mnogih nas – vjerojatno većina nas – čak i znanja. U tom procesu dobivamo AI “prijatelje”, ali po kojoj cijeni? Što gubimo, posebno u pogledu slobodne volje i agencije?

Autor i financijski komentator Kyla skenik govorio o Ezra Klein Podcast o tome kako lakoća digitalnog svijeta bez trenja može doći po cijenu značenja. Kako je rekla: “Kad su stvari malo previše jednostavne, teško je pronaći značenje u njemu … ako ste u mogućnosti položiti, pogledajte zaslon u svojoj maloj stolici i dostavite vam smoothieje – teško je pronaći značenje unutar takve vrste Zid-e Životni stil jer je sve samo previše jednostavno. “

Personalizacija istine

Kako nam AI sustavi reagiraju s sve većom tečnošću, oni se također kreću prema povećanju selektivnosti. Dvojica korisnika koji postavljaju isto pitanje danas bi mogli dobiti slične odgovore, razlikujući se uglavnom vjerojatnom prirodom generativnog AI. Ipak, ovo je samo početak. AI sustavi u nastajanju izričito su dizajnirani kako bi prilagodili svoje odgovore pojedinačnim uzorcima, postupno prilagođavajući odgovore, ton, pa čak i zaključke kako bi najjače odjeknuli sa svakim korisnikom.

Personalizacija nije inherentno manipulativna. Ali postaje rizično kada je nevidljivo, neprihvatljivo ili više projektirano na uvjeravanje nego informirati. U takvim slučajevima to ne odražava samo tko smo; To usmjerava kako tumačimo svijet oko nas.

Kao što Stanford Centar za istraživanje modela temelja primjećuje u 2024 indeks transparentnostiMalo vodećih modela otkriva razlikuju li se njihovi rezultati od identiteta, povijesti ili demografije korisnika, iako je tehnička skela za takvu personalizaciju sve više na snazi i tek počinje ispitivati. Iako još uvijek nije u potpunosti ostvaren na javnim platformama, ovaj potencijal za oblikovanje odgovora na temelju zaključenih korisničkih profila, što rezultira sve više prilagođenim informativnim svjetovima, predstavlja dubok pomak koji vodeće tvrtke već prototipiraju i aktivno slijede.

Ova personalizacija može biti korisna i sigurno je to nada onima koji grade ove sustave. Personalizirana podučavanja pokazuje obećanje u pomaganju učenicima da napreduju vlastitim tempom. Aplikacije za mentalno zdravlje sve više prilagođavaju odgovore na podršku individualnim potrebama, a alati za pristupačnost prilagođavaju sadržaj kako bi zadovoljili niz kognitivnih i senzornih razlika. To su stvarni dobici.

Ali ako slične adaptivne metode postanu široko rasprostranjene na informacijama, zabavnim i komunikacijskim platformama, pred nama je dublji, zabrinjavajući pomak: transformacija iz zajedničkog razumijevanja prema prilagođenim, individualnim stvarnostima. Kad se sama istina počne prilagođavati promatraču, ona postaje krhka i sve više gljiva. Umjesto nesuglasica koja se temelje prvenstveno na različitim vrijednostima ili tumačenjima, uskoro bismo se mogli naći da se trudimo jednostavno naseliti isti činjenični svijet.

Naravno, istina je uvijek bila posredovana. U ranijim erasima prolazio je kroz ruke svećenstva, akademika, izdavača i sidra za večernje vijesti koji su služili kao vratari, oblikovajući javno razumijevanje putem institucionalnih leća. Te brojke sigurno nisu bile oslobođene od pristranosti ili dnevnog reda, ali su djelovale u široko zajedničkim okvirima.

Današnja paradigma u nastajanju obećava nešto kvalitativno drugačije: istina posredovana AI kroz personalizirani zaključak koji uokviruje, filtrira i predstavlja informacije, oblikujući ono u što korisnici vjeruju. Ali za razliku od prošlih posrednika koji su, unatoč manama, djelovali u javno vidljivim institucijama, ovi novi arbiteri komercijalno su neprozirni, neizabrani i stalno prilagođavaju, često bez objavljivanja. Njihove pristranosti nisu doktrinarno, već kodiraju se podacima o obuci, arhitekturi i neistraženim poticajima za razvojne programere.

Pomak je dubok, od uobičajene narativne filtrirane kroz autoritativne institucije do potencijalno slomljenih pripovijesti koje odražavaju novu infrastrukturu razumijevanja, prilagođene algoritmima na preferencije, navike i zaključena uvjerenja svakog korisnika. Ako je Babel predstavljao kolaps zajedničkog jezika, sada ćemo možda stajati na pragu kolapsa zajedničkog posredovanja.

Ako je personalizacija nova epiztemska supstrat, kako bi infrastruktura istine mogla izgledati u svijetu bez fiksnih posrednika? Jedna od mogućnosti je stvaranje AI javnih povjerenja, nadahnutih a prijedlog Od pravnog znanstvenika Jacka Balkina, koji je tvrdio da se entiteti koji upravljaju korisničkim podacima i oblikovanje percepcije trebaju se smatrati fiducijarnim standardima lojalnosti, brige i transparentnosti.

AI modelima bi mogli upravljati transparentnim odborima, osposobljenim za javno financirane skupove podataka i potrebni za prikazivanje koraka obrazloženja, alternativne perspektive ili razine povjerenja. Ovi „fiducijari informacija“ ne bi uklonili pristranost, već bi mogli usidriti povjerenje u proces, a ne isključivo u personalizaciji. Graditelji mogu započeti usvajanjem transparentnih “ustava” koji jasno definiraju ponašanje modela i nudeći objašnjenja lanca rezolucije koja korisnicima omogućavaju kako se zaključuju zaključci. To nisu srebrni meci, ali to su alati koji pomažu da epistemični autoritet bude odgovoran i sljediv.

Graditelji AI suočavaju se sa strateškom i građanskom točkom nagiba. Oni nisu samo optimizirali performanse; Oni se također suočavaju s rizikom da personalizirana optimizacija može fragment dijeliti stvarnost. To zahtijeva novu vrstu odgovornosti prema korisnicima: dizajniranje sustava koji poštuju ne samo njihove sklonosti, već i njihovu ulogu učenika i vjernika.

Razotkrivanje i ponovno preispitivanje

Ono što možda gubimo nije samo koncept istine, već put kroz koji smo je jednom prepoznali. U prošlosti je posredovana istina – iako nesavršena i pristrana – još uvijek bila usidrena u ljudskoj prosudbi i, često, samo sloj ili dva uklonjena iz proživljenog iskustva drugih ljudi s kojima ste poznavali ili se barem mogli odnositi.

Danas je to posredovanje neprozirno i vođeno algoritamskom logikom. I dok je ljudska agencija dugo klizila, sada riskiramo nešto dublje, gubitak kompasa koji nam je jednom rekao kad smo bili na putu. Opasnost nije samo u tome što ćemo vjerovati onome što nam stroj govori. To je da ćemo zaboraviti kako smo jednom otkrili istinu za sebe. Ono što riskiramo da izgubimo nije samo koherencija, već volja da ga potražimo. I s tim, dublji gubitak: navike razlučivanja, neslaganja i rasprave koje su nekada držale pluralističkih društava zajedno.

Ako je Babel obilježila razbijanje zajedničkog jezika, naš trenutak riskira mirno blijeđenje zajedničke stvarnosti. Međutim, postoje načini za usporavanje ili čak suzbijanje nagiba. Model koji objašnjava svoje obrazloženje ili otkriva granice njegovog dizajna može učiniti više od pojašnjenja izlaza. To može pomoći u vraćanju uvjeta za zajedničko istraživanje. Ovo nije tehničko popravljanje; To je kulturni stav. Istina je, na kraju krajeva, uvijek ovisila ne samo o odgovorima, već i o tome kako zajedno dolazimo do njih.

Web izvor