Poslovni timovi koji fino podešavaju svoje RAG modele ugradnje za bolju preciznost možda nenamjerno degradiraju kvalitetu dohvaćanja o kojoj ti cjevovodi ovise, prema novom istraživanju Redisa.

papir, "Obuka za kompozicijsku osjetljivost smanjuje generalizaciju gustog pronalaženja," testirali što se događa kada timovi treniraju modele ugradnje za osjetljivost kompozicije. To je sposobnost da uhvatite rečenice koje izgledaju gotovo identično, ali znače nešto drugačije — "pas je ugrizao čovjeka" naspram "čovjek je ugrizao psa," ili okretanje negacije koje potpuno preokreće značenje izjave. Ta je obuka dosljedno razbijala gustu generalizaciju dohvaćanja, koliko dobro model ispravno dohvaća široke teme i domene o kojima nije posebno obučen. Performanse su pale za 8 do 9 posto na manjim modelima i za 40 posto na trenutnom modelu za ugradnju srednje veličine koji timovi aktivno koriste u proizvodnji. Nalazi imaju izravne implikacije na poslovne timove koji grade agentičke AI cjevovode, gdje kvaliteta dohvaćanja određuje koji kontekst ulazi u agentov lanac razmišljanja. Pogreška dohvaćanja u jednostupanjskom cjevovodu vraća pogrešan odgovor. Ista pogreška u agentskom cjevovodu može pokrenuti kaskadu pogrešnih radnji nizvodno.

Srijith Rajamohan, voditelj istraživanja umjetne inteligencije u Redisu i jedan od autora rada, rekao je da otkriće dovodi u pitanje raširenu pretpostavku o tome kako zapravo funkcionira dohvaćanje temeljeno na ugrađivanju.

"Postoji opća ideja da kada koristite semantičko pretraživanje ili sličnu semantičku sličnost, dobivamo ispravnu namjeru. To nije nužno točno," Rajamohan je rekao za VentureBeat. "Bliska ili visoka semantička sličnost zapravo ne znači točnu namjeru."

Sadržaj objave

Geometrija koja stoji iza kompromisa dohvaćanja

Modeli ugrađivanja funkcioniraju kompresijom cijele rečenice u jednu točku u visokodimenzionalnom prostoru, a zatim pronalaženjem točaka najbližih upitu u vrijeme dohvaćanja. To dobro funkcionira za široko tematsko podudaranje — dokumenti o sličnim temama završavaju jedni blizu drugih. Problem je u tome što dvije rečenice s gotovo identičnim riječima, ali suprotnim značenjima također završe jedna blizu druge, jer model radi na temelju sadržaja riječi, a ne strukture.

To je ono što je istraživanje kvantificiralo. Kada timovi fino ugađaju model ugrađivanja kako bi razdvojili strukturno različite rečenice — podučavajući ga da negacijski preokret koji preokreće značenje izjave nije isti kao izvornik — model koristi reprezentativni prostor koji je prije koristio za široko tematsko prisjećanje. Dva cilja se natječu za isti vektor. Istraživanje je također otkrilo da regresija nije ujednačena po vrstama neuspjeha. Pogreške negacije i prostornog preokreta mjerljivo su poboljšane strukturiranim treningom. Pogreške vezanja — gdje model zbunjuje koji se modifikator primjenjuje na koju riječ, kao što je na koju stranu pada ugovorna obveza — jedva da se pomaknuo. Za poslovne timove to znači da je problem s preciznošću teže riješiti upravo u slučajevima kada pogrešno postupanje ima najviše posljedica.

Razlog zašto većina timova to ne shvaća je taj što metrika finog podešavanja mjeri zadatak za koji se trenira, a ne ono što se događa s općim dohvaćanjem nepovezanih tema. Model može pokazati značajan napredak u odbijanju zamalo promašenog slučaja tijekom obuke, dok tiho nazaduje na širem poslu pronalaženja za koji je angažiran. Regresija se pojavljuje samo u proizvodnji.

Rajamohan je rekao da instinkt za kojim većina timova poseže – prelazak na veći model ugradnje – ne bavi se temeljnom arhitekturom.

"Ne možeš se izvući iz ovoga," rekao je. "To nije problem koji možete riješiti s više dimenzija i više parametara."

Zašto sve standardne alternative ne uspijevaju

Prirodni instinkt kada preciznost pronalaženja zakaže je da se dodaju dodatni pristupi. Istraživanje je testiralo nekoliko njih i pokazalo se da svaki ne uspijeva na drugačiji način.

Hibridno pretraživanje. Kombinacija dohvaćanja temeljenog na ugrađivanju s pretraživanjem po ključnim riječima već je standardna praksa za uklanjanje nedostataka u preciznosti. Ali Rajamohan je rekao da pretraživanje ključnih riječi ne može uhvatiti način neuspjeha koji identificira ovo istraživanje, jer problem nisu riječi koje nedostaju – to je pogrešno pročitana struktura.

"Ako imate rečenicu kao što je ‘Rim je bliži od Pariza’ i drugu koja kaže ‘Pariz je bliži od Rima’ i izvršite dohvaćanje ugradnje nakon čega slijedi pretraživanje teksta, nećete moći uočiti razliku," rekao je. "Iste riječi postoje u obje rečenice."

Ponovno rangiranje MaxSima. Neki timovi dodaju drugi sloj bodovanja koji uspoređuje pojedinačne riječi upita s pojedinačnim riječima dokumenta umjesto da se oslanja na jedan komprimirani vektor. Ovaj pristup, poznat kao MaxSim ili kasna interakcija i korišten u sustavima poput ColBERT-a, poboljšao je rezultate referentnih vrijednosti u istraživanju. Ali potpuno je propustio odbaciti strukturne zamalo promašaje, dodijelivši im rezultate sličnosti gotovo identične.

Problem je u tome što su relevantnost i identitet različiti ciljevi. MaxSim je optimiziran za prvo i slijep za drugo. Tim koji dodaje MaxSim i vidi poboljšanje referentne vrijednosti možda rješava problem drugačiji od onoga koji ima.

Unakrsni koderi. Oni rade tako da upit i kandidatski dokument unose u model istovremeno, dopuštajući mu da usporedi svaku riječ sa svakom riječju prije donošenja odluke. Ta potpuna usporedba je ono što ih čini točnima – i ono što ih čini preskupima za rad u proizvodnom opsegu. Rajamohan je rekao da ih je njegov tim istražio. Oni rade u laboratoriju i probijaju se pod stvarnim količinama upita.

Kontekstualno pamćenje. Ponekad se nazivaju i agentskom memorijom, a ovi se sustavi sve više navode kao put izvan RAG-a, ali Rajamohan je rekao da prelazak na tu vrstu arhitekture ne eliminira problem strukturnog dohvaćanja. Ti sustavi još uvijek ovise o dohvaćanju u vrijeme upita, što znači da se primjenjuju isti načini neuspjeha. Glavna razlika su zahtjevi za labavijom latencijom, a ne precizni popravak.

Popravak u dvije faze potvrđen je istraživanjem

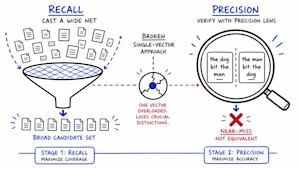

Zajednička nit u svakom neuspješnom pristupu je ista: jedan mehanizam bodovanja koji pokušava upravljati i prisjećanjem i preciznošću odjednom. Istraživanje je potvrdilo drugačiju arhitekturu: prestanite pokušavati obavljati oba posla s jednim vektorom i dodijelite svaki posao posebnoj fazi.

Prva faza: opoziv. Prva faza radi točno onako kako danas radi standardno gusto dohvaćanje — model ugradnje komprimira dokumente u vektore i dohvaća ono što je najbliže upitu. Ovdje se ništa ne mijenja. Cilj je baciti široku mrežu i brzo vratiti niz jakih kandidata. U ovoj fazi bitne su brzina i širina, a ne savršena preciznost.

Druga faza: preciznost. U drugoj fazi nalazi se popravak. Umjesto bodovanja kandidata s jednim brojem sličnosti, mali naučeni Transformer model ispituje upit i svakog kandidata na razini tokena — uspoređujući pojedinačne riječi s pojedinačnim riječima kako bi se otkrile strukturne neusklađenosti poput negacijskih okreta ili promjena uloga. Ovo je korak provjere koji jednovektorski pristup ne može izvesti.

Rezultati. Pod obukom od kraja do kraja, verifikator Transformer nadmašio je svaki drugi pristup testiran u istraživanju o strukturnom odbijanju skorog promašaja. Bio je to jedini pristup koji je pouzdano uhvatio načine kvara koje je jednovektorski sustav propustio.

Kompromis. Dodavanje faze provjere košta kašnjenje. Trošak kašnjenja ovisi o tome koliko provjere tim provodi. Za radna opterećenja osjetljiva na preciznost kao što su pravne ili računovodstvene aplikacije, zajamčena je potpuna provjera pri svakom upitu. Za pretraživanje opće namjene, lakša provjera može biti dovoljna.

Istraživanje je proizašlo iz stvarnog proizvodnog problema. Poslovni korisnici koji su pokretali sustave semantičkog predmemoriranja dobivali su brze, ali semantički netočne odgovore — sustav za pronalaženje tretirao je upite sličnog zvuka kao identične čak i kad im se značenje razlikovalo. Dvostupanjska arhitektura Redisov je predloženi popravak, s ugradnjom u njegov LangCache proizvod na planu puta, ali još nije dostupan korisnicima.

Što to znači za poslovne timove

Istraživanje ne zahtijeva od timova poduzeća da ponovno izgrade svoje cjevovode za dohvaćanje od nule. Ali traži od njih da testiraju pretpostavke koje većina timova nikada nije ispitala – o tome što njihovi modeli ugrađivanja zapravo rade, kojim mjernim podacima vrijedi vjerovati i gdje se nalaze stvarni nedostaci u preciznosti u proizvodnji.

Prepoznajte kompromis prije nego što ga prilagodite. Rajamohan je rekao da je prvi praktični korak razumijevanje postojanja regresije. On procjenjuje bilo koji sustav za pretraživanje temeljen na LLM-u prema tri kriterija: ispravnosti, potpunosti i korisnosti. Neuspjesi ispravnosti kaskadno se slijevaju izravno u druga dva, što znači da sustav za pronalaženje koji ima dobre rezultate na referentnim vrijednostima relevantnosti, ali ne uspijeva na strukturalnim zamajcima stvara lažan osjećaj spremnosti za proizvodnju.

RAG nije zastario — ali znajte što ne može. Rajamohan je čvrsto odbacio tvrdnje da je RAG zamijenjen. "To je veliko pretjerano pojednostavljivanje," rekao je. "RAG je vrlo jednostavan cjevovod koji može proizvesti gotovo svatko uz vrlo malo dizanja." Istraživanje se ne protivi RAG-u kao arhitekturi. Protivi se pretpostavci da je jednofazni RAG cjevovod s fino podešenim modelom ugrađivanja spreman za proizvodnju za radna opterećenja osjetljiva na preciznost.

Popravak je stvaran, ali nije besplatan. Za timove koji trebaju veću preciznost, Rajamohan je rekao da dvostupanjska arhitektura nije pretjerano povećanje implementacije, ali dodavanje faze provjere košta kašnjenje. "To je problem ublažavanja," rekao je. "Nije nešto što zapravo možemo riješiti."